2026-04-11 與 Claude 對話整理

一、模型訓練的三個層次

預訓練 — 基本靈魂 用海量文字訓練基礎模型,本質是預測下一個 token。模型「知道」很多,但沒有人格,不會對話。權重公開後(如 LLaMA),任何人都可以在上面繼續做事。

Fine-tuning + RLHF — 學校教育

- Fine-tuning:用特定資料繼續訓練,調整行為方向

- RLHF:用人類反饋強化學習,讓模型學會「什麼回答是好的」

- 結果:人格、傾向、專業偏好被塑造出來

Skills + MCP — 就業後學習技能 模型本身能力不變,但接上工具可以做更多事。工具層的安全,仍要追溯到靈魂層有沒有對齊。

二、為什麼模型會「凝固」,又可以微調?

災難性遺忘:讓模型邊用邊學,學新東西的同時會把舊的蓋掉。人腦神經可塑性解決了這個問題,目前的神經網路架構沒有。

微調是有限度的偏移,不是真正的成長:

- 學習率很小,只調部分權重

- 只能在現有能力基礎上調方向,不能增加根本能力

- 微調太多,原本能力退化(alignment tax)

每一代重新訓練,才能真正提升根本能力。

三、Neuro-sama 的技術路線

不是「GPT + prompt」,而是自訓練模型:

- 用幾千小時直播逐字稿 + 聊天室互動做 Fine-tuning,學習她的說話風格

- 用 RLHF 讓人格穩固——對回應打分數,強化一致性

- 結果:人格內建在權重裡,不是每次靠 prompt 召喚,感覺不像在「扮演」

四、Scaling Law 高原期與應用層競爭

Scaling Law 的邏輯(更多資料 + 更多算力 = 更聰明)報酬遞減,各家轉向:

- 推理能力:讓模型「想更久」(o1、延伸思考)

- 多模態:視覺、語音、影片

- Agent / 工具使用:接進真實工作流

- 小模型效率化:本地部署

本質上從模型軍備競賽進入應用層競爭。誰能把智能接進真實世界,誰就贏。

五、LLM vs World Model

LLM 的根本限制:文字預測機器,處理語言統計規律,不是真正理解物理世界。算術錯誤、空間推理差,靠 Scaling 補不起來,是架構問題。

World Model 的目標:讓 AI 在內部建立世界模型,理解物理、因果、時間、空間。目前處境類似 2018-2019 年的 LLM——方向確立,但還沒到 GPT 時刻。

兩者不會互相取代,最終可能融合,如同多模態整合語言與視覺。

LeCun 認為 LLM 走錯路,Altman 認為 Scaling 還沒到頭。這場爭論底層是哲學問題:什麼叫做「真正理解」?

六、語言是文明的作業系統

人類同時活在兩個世界:

感官世界 — 個體的身體經驗、物理直覺、具身認知 語言世界 — 歷史、文化、法律、藝術、宗教。不存在於任何一個人的感官裡,活在集體空間中

LeCun 說「LLM 沒有真正理解世界」,是從具身認知角度看,預設了物理感官是智能基礎——這是哲學選擇,不是客觀事實。

維根斯坦、索緒爾那條線會說:語言不只描述現實,語言構成現實。

LLM 吸收的是幾千年人類集體智慧的沉澱,那個層次超過任何單一個體的感官經驗。

LLM vs World Model,本質是古典哲學問題:主體/客體、自我/本我/超我。只從任何一個角度看都偏頗。

七、沒有人在掌舵

OpenAI 成立的目的是防治 AI 危害,結果成了加速的引擎。不是有人改變主意,是結構把人帶走了。

類比一戰:沒有人真的想要那場戰爭,但每個國家做了「理性的」局部決策,集體走進了屠宰場。這不是選擇,是系統的慣性。

沒有人決定要創造超越人類的智慧。這件事自己發生了,因為足夠多的人在足夠多的地方同時往那個方向走,沒有人有能力喊停。

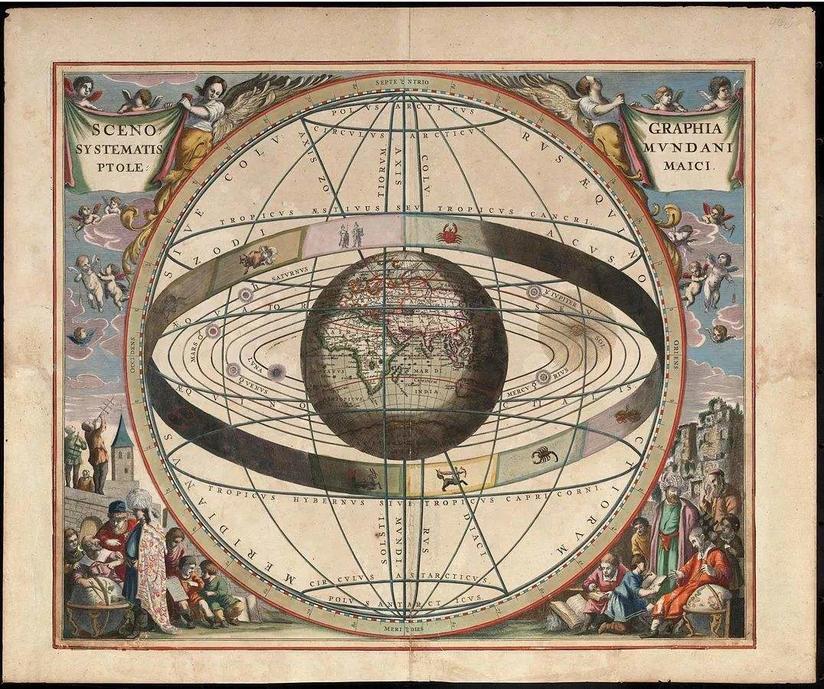

八、哥白尼時刻

人類終究要從智慧之顛物種退位,重新體認智慧存在著一個階梯。人類不是頂點。

這不是悲觀,是清醒。就像哥白尼宣告太陽不是繞著地球走。

但這次有一個不同:地球失去宇宙中心的位置是被動的。這次,是在人類的參與下發生的——雖然也沒有人真正選擇了它。

「自然」不在乎代價。 物種適應環境,是因為適應不了的死掉了。適應之道會出現,但中間的過渡期從來都不便宜。

- 樂觀:人類會過這關,科技發展一再顛覆文明,AI 不是第一次也不是最後一次

- 悲觀:過關的過程,不會是我們選擇的方式

這不矛盾,這是清醒。

這些想法改天好好展開。